实况龟壳阵容(龟壳怎么吃)

来源:3D视觉工坊

添加小助理:dddvision,备注:方向+学校/公司+昵称,拉你入群。文末附行业细分群

0.这篇文章干了啥?

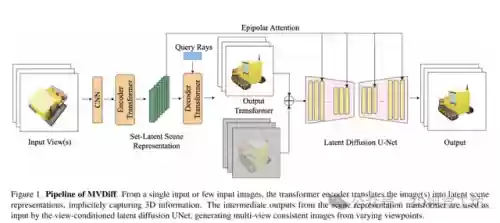

这篇文章提出了一种用于从单个输入图像生成一致多视图图像的方法。为了解决这一问题,文章引入了对极几何约束和多视图注意力机制,以确保生成的多视图图像在几何上一致。具体来说,文章提出了一个包含场景表示变换器(SRT)和基于视图条件的扩散模型的框架。SRT用于学习隐式的3D表示,而基于视图条件的扩散模型用于生成目标视图的条件分布。通过这种方法,文章展示了在3D重建任务中生成高质量的3D网格的能力,超过了现有方法的基线水平。文章还进行了大量的实验验证,并提出了未来工作的方向,包括结合图形技术以生成更加多样化的3D形状。

下面一起来阅读一下这项工作~

1. 论文信息

论文题目:MVDiff: Scalable and Flexible Multi-View Diffusion for 3D Object Reconstruction from Single-View

作者:Emmanuelle Bourigault等

作者机构:University of Oxford等

论文链接:https://arxiv.org/pdf/2405.03894

2. 摘要

为了实现一致的多视角生成以用于3D重建任务,现有的图像到3D扩散模型仍然面临挑战。通常,将3D表示引入扩散模型会降低模型的速度、泛化能力和质量。本文提出了一个通用框架,用于从单个图像生成一致的多视角图像,或者利用场景表示变换器和视图条件扩散模型。在模型中,我们引入了对极几何约束和多视角注意力,以强制执行3D一致性。从仅有的一个图像输入开始,我们的模型能够生成超越基线方法的3D网格,在评估指标(包括PSNR、SSIM和LPIPS)方面表现优异。

3. 效果展示

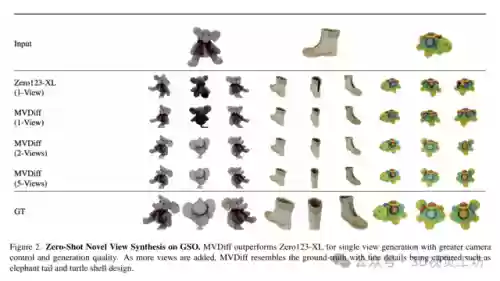

GSO上的零样本新视图合成。MVDiff在单视图生成方面优于Zero123-XL,具有更大的摄像机控制和生成质量。随着添加更多视图,MVDiff与地面实况更加相似,能够捕捉到如大象尾巴和乌龟壳设计等细节。

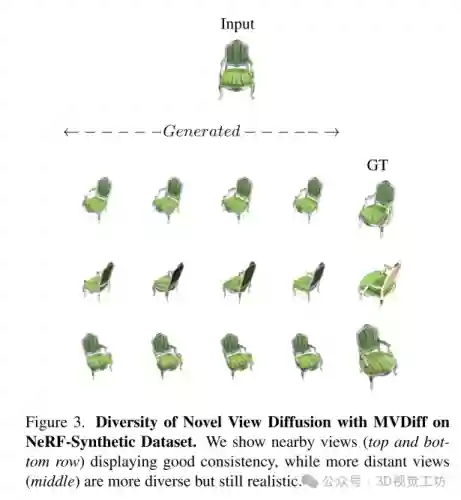

MVDiff在NeRF合成数据集上的新视图扩散多样性。我们展示了附近视图(顶部和底部行)具有良好的一致性,而更远的视图(中间)更加多样化但仍然逼真。

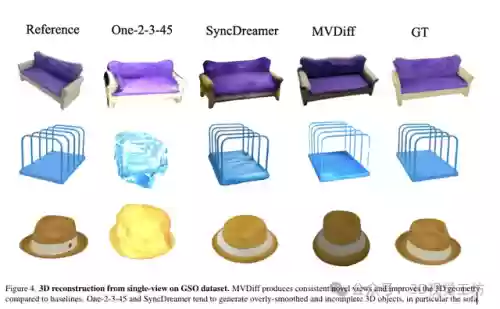

在GSO数据集上从单视图进行的3D重建。MVDiff生成一致的新视图,并改善了与基线相比的3D几何形状。One-2-3-45和SyncDreamer倾向于生成过度平滑和不完整的3D对象,特别是沙发。

4. 主要贡献

使用几何指导进行隐式3D表示学习

多视角自注意力以加强视图一致性

可扩展和灵活的框架

5. 基本原理是啥?

这篇文章的基本原理是利用场景表示变换器(SRT)和视图条件扩散模型来生成一致的多视图图像,从而实现对3D对象的精确重建。文章的关键点如下:

多视角条件扩散模型:文章提出了一种新的模型结构,旨在从单个或少量输入视图中学习潜在的3D表示,并使用视图条件扩散模型生成新视图。这种模型能够在训练过程中强制执行多视角一致性,从而提高生成的新视图的准确性和一致性。

对极几何约束:为了增强生成的多视图的一致性,文章引入了对极几何约束。通过计算不同视图之间的对极线和对极距离,可以构建加权亲和矩阵,从而促使模型学习视图之间的几何对应关系。

视图条件隐性扩散模型:为了更好地恢复图像的细节,文章采用了视图条件隐性扩散模型,该模型能够估计目标视图在给定源视图和相对相机姿态的情况下的条件分布。通过这种方式,模型可以更好地生成具有细节和准确性的新视图。

6. 实验结果

本文的实验主要围绕新视图合成和3D生成展开:

训练数据和测试数据:

训练数据:使用800k个3D对象模型进行训练,数据来源为Objaverse。

测试数据:使用Google Scanned Object (GSO)数据集进行测试,共30个对象,每个对象有16张图像。

实现细节:

优化器和学习率:使用AdamW优化器,初始学习率为10^-4,训练100k步后降至10^-5。

训练批次:每个训练批次包含3个输入视图和3个目标视图,共有12个视图可供选择,批量大小为356。

训练时长:在4个A6000 (48GB) GPU上训练6天。

评估指标:

新视图合成:评估指标包括PSNR、SSIM和LPIPS。

3D重建:使用Chamfer距离(CD)和3D IoU评估重建效果。

实验结果:

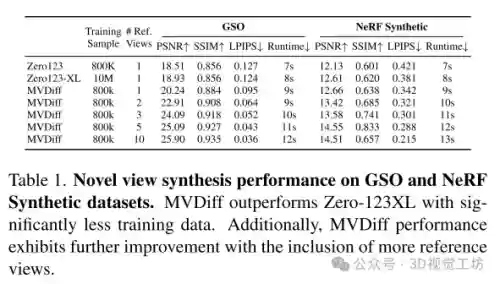

新视图合成:MVDiff模型在未见过的数据集上表现优于Zero-123XL模型,且能够生成多样化和逼真的形状。

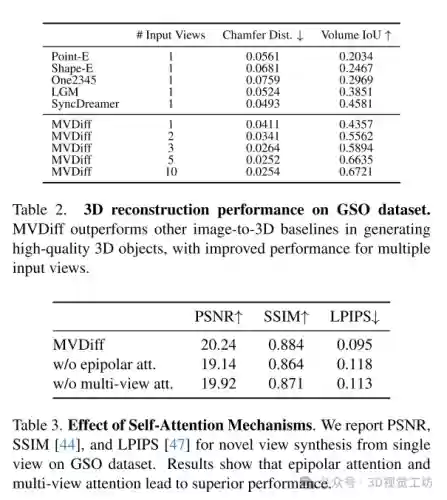

3D生成:MVDiff模型在生成一致的多个新视图方面表现优异,与其他基线模型相比,能够更好地恢复形状。

消融研究:

多视图一致性:需要生成多个实例并选择最佳实例进行3D重建。

对极和多视图注意力:实验结果表明,对极注意力在几何引导方面起到了重要作用。

权重初始化:

使用Zero123对视角对象训练的权重初始化模型表现优于使用Stable Diffusion v2的权重初始化模型。

7. 总结 & 未来工作

在本研究中,我们旨在解决单视图多视图合成中存在的不一致性问题。我们特别应用了对极注意力机制以及多视图注意力来聚合多个视图的特征。我们提出了一个简单灵活的框架,能够根据任意数量的图像生成高质量的多视图图像。

未来工作 结合图形技术。在本研究中,我们展示了通过在训练过程中学习视图间的几何对应关系,可以生成视图一致的3D对象。我们修改了潜在扩散U-Net模型以输入多视图,以生成用于3D重建的一致多视图。未来的工作可以探索利用关于光照和纹理的知识,以生成具有不同光照和纹理的更多样化的3D形状。

本文仅做学术分享,如有侵权,请联系删文。

3D视觉工坊交流群

目前我们已经建立了3D视觉方向多个社群,包括2D计算机视觉、大模型、工业3D视觉、SLAM、自动驾驶、三维重建、无人机等方向,细分群包括:

2D计算机视觉:图像分类/分割、目标/检测、医学影像、GAN、OCR、2D缺陷检测、遥感测绘、超分辨率、人脸检测、行为识别、模型量化剪枝、迁移学习、人体姿态估计等

大模型:NLP、CV、ASR、生成对抗大模型、强化学习大模型、对话大模型等

工业3D视觉:相机标定、立体匹配、三维点云、结构光、机械臂抓取、缺陷检测、6D位姿估计、相位偏折术、Halcon、摄影测量、阵列相机、光度立体视觉等。

SLAM:视觉SLAM、激光SLAM、语义SLAM、滤波算法、多传感器融合、多传感器标定、动态SLAM、MOT SLAM、NeRF SLAM、机器人导航等。

自动驾驶:深度估计、Transformer、毫米波|激光雷达|视觉摄像头传感器、多传感器标定、多传感器融合、自动驾驶综合群等、3D目标检测、路径规划、轨迹预测、3D点云分割、模型部署、车道线检测、Occupancy、目标跟踪等。

三维重建:3DGS、NeRF、多视图几何、OpenMVS、MVSNet、colmap、纹理贴图等

无人机:四旋翼建模、无人机飞控等

除了这些,还有求职、硬件选型、视觉产品落地、最新论文、3D视觉最新产品、3D视觉行业新闻等交流群

添加小助理: dddvision,备注:研究方向+学校/公司+昵称(如3D点云+清华+小草莓), 拉你入群。

3D视觉工坊知识星球

3DGS、NeRF、结构光、相位偏折术、机械臂抓取、点云实战、Open3D、缺陷检测、BEV感知、Occupancy、Transformer、模型部署、3D目标检测、深度估计、多传感器标定、规划与控制、无人机仿真、三维视觉C++、三维视觉python、dToF、相机标定、ROS2、机器人控制规划、LeGo-LAOM、多模态融合SLAM、LOAM-SLAM、室内室外SLAM、VINS-Fusion、ORB-SLAM3、MVSNet三维重建、colmap、线面结构光、硬件结构光扫描仪,无人机等。